Sponsoring für interwoven

Wie gewinnt man Sponsoren für ein studentisches Event, und welche Herausforderungen treten dabei auf? Im Mittelpunkt stehen dabei vor allem Fragen wie: Wo liegen die typischen Fallstricke? Was muss besonders beachtet werden? Wie geht man Schritt für Schritt vor? Und auch: Welche inneren Widerstände treten im Prozess auf?

Das Sponsoring-Team von Event Media beginnt damit, Unternehmen anzusprechen, die das Projekt bereits in der Vergangenheit unterstützt haben oder dem Team bereits bekannt sind. Dieser erste Schritt erleichtert den Einstieg, da bereits bestehende Kontakte genutzt werden können. Erst im Anschluss erfolgt eine gezielte Recherche nach neuen potenziellen Partnern.

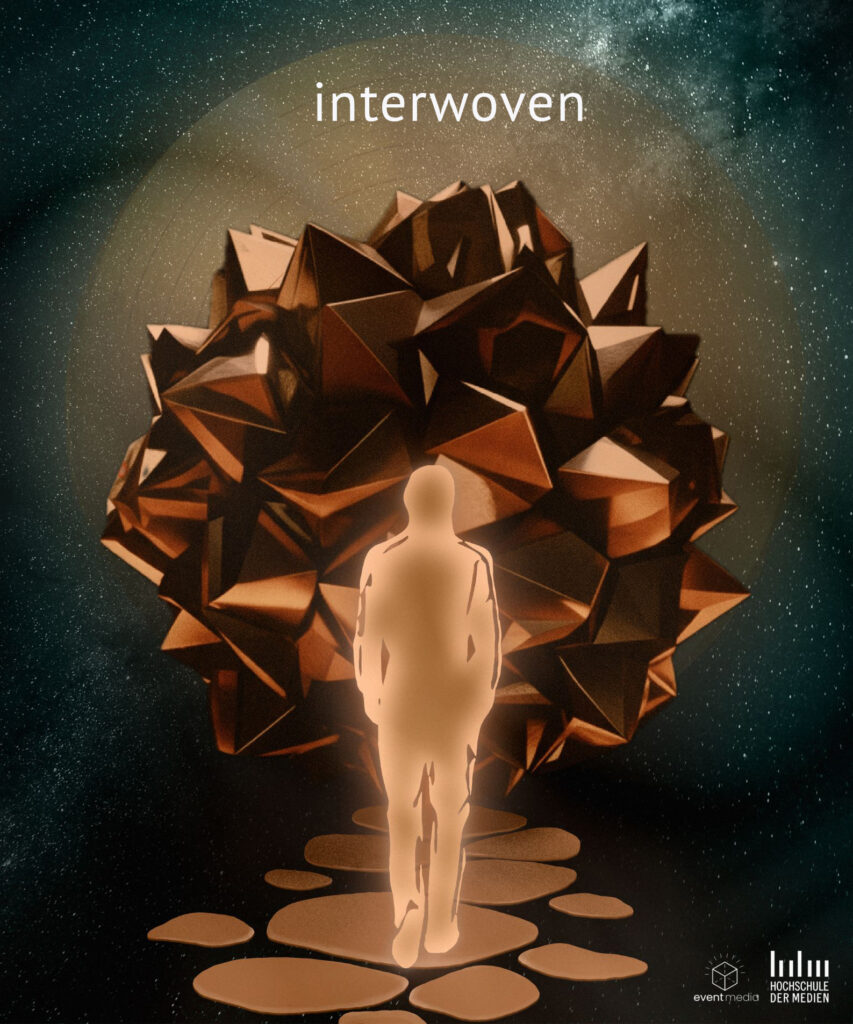

Besonders bei unserer Produktion einer Spatial Experience spielt die inhaltliche Ausrichtung eine bedeutende Rolle. Im Gegensatz zu Formaten wie Kinderbuchprojekten oder klassischen Ausstellungen, bei denen kulturelle Exponate im Vordergrund stehen, arbeiten wir mit einer durchgehenden Narration. Ausgangspunkt ist die Frage, wie auf die von der Menschheit verschickte Goldene Schallplatte geantwortet werden könnte.

Auch die Ansprache der Unternehmen zeigt sich als anspruchsvoll. Dabei wird deutlich, dass eine gute Vorbereitung entscheidend ist. So ist es wichtig, sich intensiv mit den jeweiligen Unternehmen auseinanderzusetzen, beispielsweise durch die Analyse ihrer Website und ihres Profils, um ein Verständnis für deren Ausrichtung und Werte zu entwickeln.

Auf dieser Grundlage muss die Ansprache individuell formuliert werden. Dabei gilt es, das richtige Maß im Wording zu finden: Die Kommunikation sollte professionell wirken, ohne zu distanziert oder zu stark „corporate“ zu sein, gleichzeitig aber auch nicht zu locker oder umgangssprachlich. Ziel ist es, eine passende und authentische Ansprache zu wählen, die zum jeweiligen Unternehmen passt.

Zudem spielt auch die eigene Unsicherheit eine große Rolle im Sponsoringprozess. Bereits bei der ersten Kontaktaufnahme tauchen Fragen auf: Sind wir vielleicht zu früh oder schon zu spät dran? Werden unsere Anfragen überhaupt wahrgenommen? Bleiben Antworten aus, führt das schnell dazu, dass E-Mails immer wieder überprüft werden und die Erwartung auf eine Rückmeldung wächst. Wenn diese nicht erscheint, entsteht Enttäuschung und gleichzeitig die Unsicherheit, wie es weitergehen soll. Besonders das geplante Nachfassen wirft neue Fragen auf: Wie lässt sich eine Erinnerung formulieren, ohne aufdringlich zu wirken? Wie oft ist Nachhaken passend? Hierbei entsteht Spannung zwischen dem Wunsch nach einer Reaktion und dem eigenen Anspruch, professionell und zurückhaltend aufzutreten. Sponsoring erfordert nicht nur organisiertes Vorgehen, sondern auch den Umgang mit den eigenen Erwartungen und Unsicherheiten umgehen zu können, vor allem in Momenten, in denen Entscheidungen und Reaktionen von außen noch fehlen.

Die Arbeit ist geprägt von Abstimmungen, Anpassungen und dem Umgang mit Absagen. Insgesamt zeigt sich, dass Sponsoring ein schrittweiser Prozess ist, bei dem neben einer guten Organisation auch Ausdauer und Geduld eine zentrale Rolle spielen.

Beitrag von Selina Pross & Fatlinda Molliqaj